KI-Vorsprung

KI-Vorsprung

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Statistik hat keinen guten Ruf. Für die meisten Menschen ist sie eine trockene Angelegenheit, die man in der Schule oder im Studium über sich ergehen ließ und dann so schnell wie möglich wieder vergaß. Dabei ist Statistik nichts anderes als die Kunst, aus Daten Erkenntnisse zu gewinnen. Und genau das macht sie für jeden interessant, der sich ernsthaft mit Sportwetten beschäftigt.

Wenn KI-Systeme Prognosen für Champions-League-Spiele erstellen, tun sie im Kern nichts anderes als Statistik zu betreiben. Sie sammeln Daten, analysieren Muster, berechnen Wahrscheinlichkeiten und übersetzen diese in Empfehlungen. Der Unterschied zum menschlichen Analysten liegt nicht in der grundlegenden Methodik, sondern in der Geschwindigkeit und dem Umfang der Verarbeitung. Ein Computer kann in Sekunden durchführen, wofür ein Mensch Stunden bräuchte.

Dieser Artikel richtet sich an alle, die verstehen wollen, was hinter den Kulissen passiert. Wir werden keine Formeln auswendig lernen müssen, aber wir werden die Konzepte begreifen, die KI-Prognosen zugrunde liegen. Das Ziel ist nicht, selbst zum Statistiker zu werden, sondern die Ergebnisse von KI-Systemen kritisch einordnen zu können. Denn wer die Methoden versteht, erkennt auch deren Grenzen.

Warum Fußball ein statistisches Problem ist

Auf den ersten Blick scheint Fußball das Gegenteil von Statistik zu sein. Elf gegen elf, ein Ball, zwei Tore, neunzig Minuten Chaos. Die schönsten Momente des Spiels, die genialen Dribblings, die unmöglichen Tore, die dramatischen Wendungen, lassen sich nicht in Zahlen fassen. Und doch ist Fußball auch ein statistisches Phänomen, das bestimmten Gesetzmäßigkeiten folgt.

Die zentrale Eigenschaft von Fußballspielen aus statistischer Sicht ist ihre Wiederholbarkeit. Jedes Wochenende finden hunderte Spiele statt, jede Saison tausende. Diese Masse an Daten ermöglicht es, Muster zu erkennen, die im Einzelfall unsichtbar bleiben. Ein Team mag in einem Spiel überraschend verlieren, aber über viele Spiele hinweg setzt sich die wahre Spielstärke durch. Die Statistik nennt das Regression zur Mitte, und es ist eines der robustesten Phänomene im Sport.

Ein weiterer Aspekt ist die relative Seltenheit von Toren. In einem durchschnittlichen Fußballspiel fallen etwa 2,5 bis 3 Tore. Das bedeutet, dass einzelne Treffer großen Einfluss auf das Ergebnis haben. Ein verschossener Elfmeter, ein Pfosten, eine Fehlentscheidung des Schiedsrichters kann über Sieg und Niederlage entscheiden. Diese Zufälligkeit macht Fußball spannend für Zuschauer, aber auch analysierbar für Statistiker. Denn die Verteilung von Toren folgt mathematischen Gesetzen, die sich modellieren lassen.

Die Champions League bietet für statistische Analysen besondere Bedingungen. Die Datenlage ist exzellent, weil alle Spiele auf höchstem Niveau dokumentiert werden. Die teilnehmenden Teams sind relativ homogen in ihrer Qualität, was die Prognosen anspruchsvoller macht als bei Spielen zwischen Erst- und Viertligisten. Und die Bedeutung des Wettbewerbs sorgt dafür, dass Teams ihre beste Leistung abrufen, was die Daten aussagekräftiger macht.

Die Poisson-Verteilung: Das Herzstück der Torprognose

Wenn es eine einzige statistische Verteilung gibt, die jeder Wettinteressierte kennen sollte, dann ist es die Poisson-Verteilung. Sie beschreibt die Wahrscheinlichkeit, dass eine bestimmte Anzahl von Ereignissen in einem festen Zeitraum eintritt, wenn diese Ereignisse unabhängig voneinander und mit konstanter durchschnittlicher Rate auftreten. Tore in einem Fußballspiel erfüllen diese Bedingungen annähernd.

Die Grundidee ist einfach. Wenn ein Team im Durchschnitt 1,5 Tore pro Spiel erzielt, dann ist die Wahrscheinlichkeit für genau null Tore, genau ein Tor, genau zwei Tore und so weiter durch die Poisson-Verteilung gegeben. Der einzige Parameter, den man kennen muss, ist der Erwartungswert, also die durchschnittliche Toranzahl. Daraus lassen sich alle Einzelwahrscheinlichkeiten berechnen.

In der Praxis bedeutet das: Wenn wir den erwarteten Torwert für beide Teams eines Spiels kennen, können wir die Wahrscheinlichkeiten für alle möglichen Endergebnisse berechnen. Die Summe der Wahrscheinlichkeiten für alle Ergebnisse, bei denen das Heimteam gewinnt, ergibt die Heimsieg-Wahrscheinlichkeit. Analog für Unentschieden und Auswärtssieg. Diese Wahrscheinlichkeiten lassen sich dann mit den Buchmacher-Quoten vergleichen.

Ein konkretes Beispiel verdeutlicht das. Nehmen wir an, ein KI-Modell errechnet für ein Champions-League-Spiel einen erwarteten Torwert von 1,8 für das Heimteam und 1,2 für das Auswärtsteam. Mit der Poisson-Verteilung können wir nun die Wahrscheinlichkeiten für jedes Ergebnis von 0:0 bis, sagen wir, 5:5 berechnen. Die Wahrscheinlichkeit für ein 2:1 wäre etwa 12 Prozent, für ein 1:1 etwa 14 Prozent. Addiert man alle Heimsieg-Szenarien, kommt man vielleicht auf 52 Prozent Heimsieg-Wahrscheinlichkeit.

Die Poisson-Verteilung ist nicht perfekt. Sie nimmt an, dass die Torerzielung der beiden Teams unabhängig voneinander ist, was in der Realität nicht ganz stimmt. Ein frühes Tor kann die Spielstrategie beider Teams verändern. Sie berücksichtigt auch nicht, dass Tore in bestimmten Spielphasen wahrscheinlicher sind als in anderen. Dennoch liefert sie eine erstaunlich gute Annäherung an die tatsächlichen Ergebnisverteilungen und bildet die Grundlage vieler KI-Prognosemodelle.

Regression: Zusammenhänge erkennen und nutzen

Während die Poisson-Verteilung einzelne Spiele modelliert, hilft die Regressionsanalyse dabei, die Faktoren zu identifizieren, die Spielausgänge beeinflussen. Die Grundfrage lautet: Welche Variablen hängen mit dem Ergebnis zusammen, und wie stark ist dieser Zusammenhang?

Die einfachste Form ist die lineare Regression. Sie untersucht den Zusammenhang zwischen einer abhängigen Variable, etwa den erzielten Toren, und einer oder mehreren unabhängigen Variablen, etwa dem Ballbesitz oder der Schussanzahl. Das Ergebnis ist eine Gleichung, die vorhersagt, wie sich die abhängige Variable verändert, wenn sich die unabhängigen Variablen verändern.

In der Fußballanalyse werden typischerweise viele Variablen gleichzeitig betrachtet. Ein Regressionsmodell könnte untersuchen, wie Ballbesitz, Passgenauigkeit, Schüsse aufs Tor, Expected Goals, Pressing-Intensität und Heimvorteil zusammen die erzielten Tore vorhersagen. Die Koeffizienten der Regression zeigen dann, welche Faktoren den stärksten Einfluss haben und welche vernachlässigbar sind.

Für KI-Systeme ist Regression ein Werkzeug zur Gewichtung. Sie hilft zu entscheiden, welche Datenpunkte in die Prognose einfließen sollen und mit welchem Gewicht. Ein Modell könnte beispielsweise herausfinden, dass Expected Goals ein viel besserer Prädiktor für zukünftige Leistungen sind als tatsächlich erzielte Tore. Diese Erkenntnis würde dann die Gewichtung in der Prognose beeinflussen.

Die Herausforderung bei der Regression liegt in der Auswahl der richtigen Variablen. Zu wenige Variablen führen zu ungenauen Prognosen, zu viele führen zum Problem der Überanpassung. Ein Modell, das auf historischen Daten perfekt funktioniert, kann bei neuen Daten versagen, weil es Zufallsmuster gelernt hat statt echter Zusammenhänge. Die Kunst liegt in der Balance.

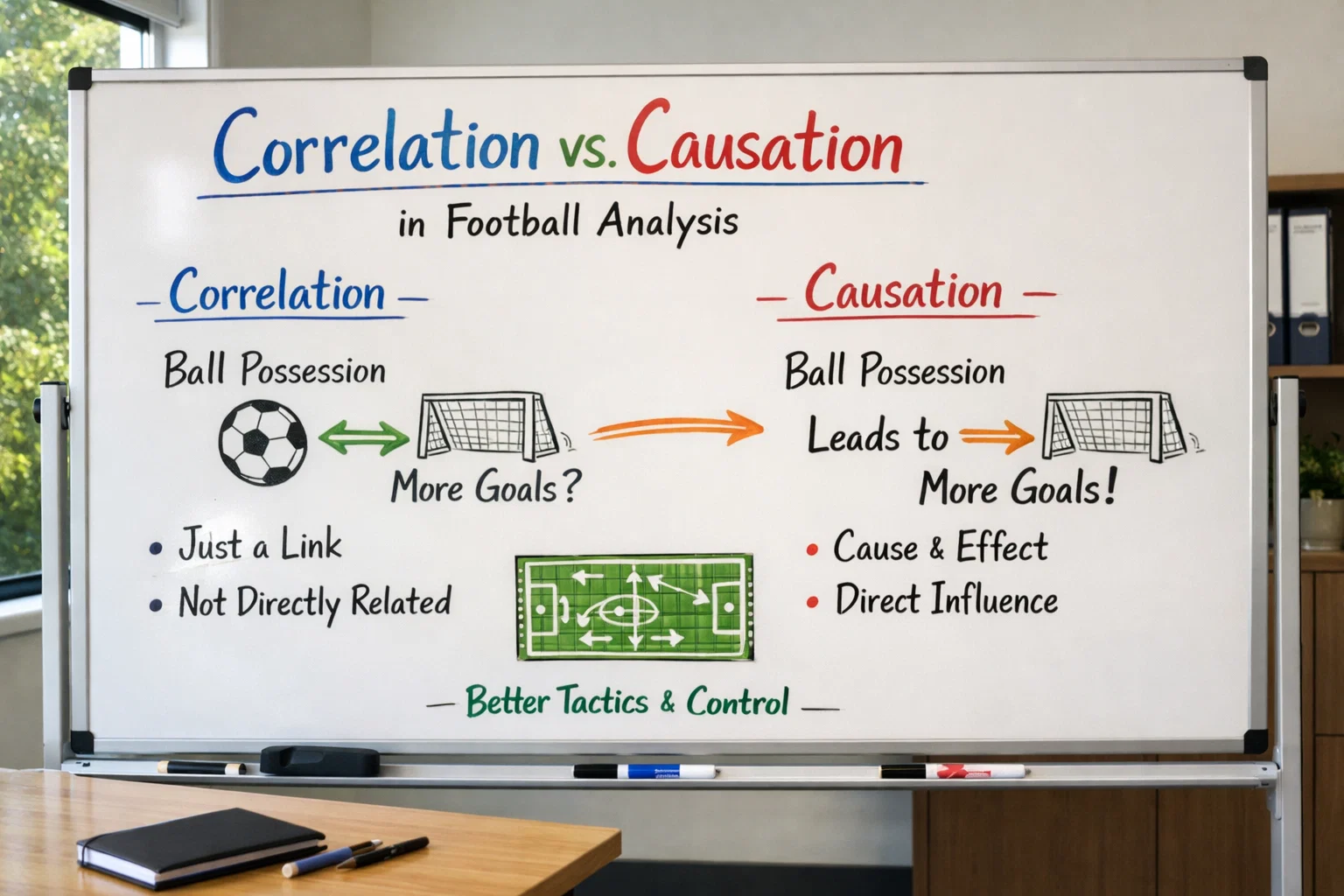

Korrelation versus Kausalität: Die wichtigste Unterscheidung

Wenn zwei Variablen zusammen auftreten, bedeutet das nicht, dass eine die andere verursacht. Diese scheinbar triviale Einsicht ist eine der wichtigsten in der Statistik und wird dennoch ständig missachtet. Für die Interpretation von KI-Prognosen ist sie fundamental.

Ein klassisches Beispiel aus dem Fußball: Teams mit hohem Ballbesitz gewinnen häufiger. Daraus könnte man schließen, dass Ballbesitz zum Sieg führt. Aber die Kausalität könnte auch umgekehrt sein. Teams, die in Führung liegen, lassen sich zurückfallen und überlassen dem Gegner den Ball. Der hohe Ballbesitz des Gegners wäre dann nicht Ursache, sondern Folge des Spielstands.

Ein anderes Beispiel: Teams, die viele Eckbälle haben, gewinnen häufiger. Führt also das Training von Eckball-Varianten zum Erfolg? Wahrscheinlich nicht. Eckbälle sind ein Zeichen dafür, dass ein Team den Gegner unter Druck setzt und häufig in dessen Strafraum kommt. Die Eckbälle selbst sind wenig effektiv, aber sie korrelieren mit offensiver Dominanz, die wiederum zum Sieg führt.

Für KI-Systeme ist die Unterscheidung zwischen Korrelation und Kausalität relevant, weil sie beeinflusst, wie Prognosen interpretiert werden sollten. Ein Modell, das auf Korrelationen basiert, kann gute Vorhersagen liefern, solange die zugrunde liegenden Muster stabil bleiben. Wenn sich die Spielweise verändert, können die Korrelationen jedoch zusammenbrechen.

Ein konkretes Beispiel aus der Champions League: Historisch korrelierten hohe Spielergehälter mit dem Turniererfolg. Doch die Kausalität ist komplex. Reiche Clubs können bessere Spieler verpflichten, haben bessere Infrastruktur und können Verluste besser verkraften. Das Gehalt selbst macht keine Tore, aber es korreliert mit Faktoren, die das tun. Ein Modell, das nur auf Gehaltsdaten basiert, würde aufschlussreiche Prognosen liefern, aber auch blind sein für Teams, die aus anderen Gründen stark sind.

Stichprobengröße und statistische Signifikanz

Wie viele Spiele braucht man, um eine zuverlässige Aussage über die Stärke eines Teams zu treffen? Diese Frage nach der Stichprobengröße ist zentral für jede statistische Analyse und wird im Fußballkontext oft unterschätzt.

Das Problem ist, dass Fußballsaisons relativ kurz sind. In der Bundesliga spielt ein Team 34 Ligaspiele pro Saison, dazu vielleicht 10 bis 15 Pokal- und Europapokalspiele. Das sind maximal 50 Datenpunkte pro Jahr. Für robuste statistische Aussagen ist das oft zu wenig, besonders wenn man Untergruppen betrachtet, etwa nur Auswärtsspiele gegen Top-Teams.

Die statistische Signifikanz gibt an, wie wahrscheinlich es ist, dass ein beobachtetes Ergebnis durch Zufall entstanden ist. Ein Signifikanzniveau von 5 Prozent bedeutet, dass die Wahrscheinlichkeit eines Zufallsergebnisses unter 5 Prozent liegt. Im Fußball erreichen viele scheinbar interessante Muster dieses Niveau nicht, weil die Stichproben zu klein sind.

Ein praktisches Beispiel: Ein Team gewinnt in der Hinrunde alle fünf Auswärtsspiele. Bedeutet das, dass es ein starkes Auswärtsteam ist? Statistisch gesehen ist die Stichprobe zu klein für eine belastbare Aussage. Selbst ein durchschnittliches Team könnte durch Zufall fünf Auswärtsspiele in Folge gewinnen. Erst über viele Spiele hinweg lässt sich die wahre Auswärtsstärke einschätzen.

Für KI-Systeme hat die Stichprobenproblematik direkte Konsequenzen. Modelle, die auf kurzfristigen Trends basieren, können instabil sein. Ein Spieler, der in drei Spielen jeweils getroffen hat, ist nicht automatisch ein zuverlässiger Torschütze. Die Herausforderung liegt darin, kurzfristige Informationen zu nutzen, ohne dem Rauschen zu viel Gewicht zu geben.

Die Champions League verschärft dieses Problem. Teams spielen in der Ligaphase nur acht Spiele, oft gegen sehr unterschiedliche Gegner. Die Datenbasis für Champions-League-spezifische Aussagen ist daher begrenzt. KI-Systeme müssen auf Liga-Daten zurückgreifen und diese für den europäischen Kontext anpassen, was zusätzliche Unsicherheit einführt.

Der Zielscheibenfehler: Muster sehen, wo keine sind

Der Zielscheibenfehler, im Englischen Texas Sharpshooter Fallacy genannt, ist einer der häufigsten statistischen Fehlschlüsse. Er besteht darin, zuerst die Daten zu betrachten und dann eine Hypothese zu formulieren, die zu den Daten passt. Das ist, als würde man auf eine Scheune schießen und dann die Zielscheibe um die Einschusslöcher malen.

Im Fußballkontext zeigt sich dieser Fehler oft in nachträglichen Erklärungen. Ein Team verliert drei Spiele in Folge, und Analysten finden Gründe: neue Taktik, Verletzungen, Motivationsprobleme. Vielleicht stimmen diese Erklärungen, vielleicht waren es aber auch einfach drei unglückliche Spiele. Ohne vorherige Hypothese lässt sich das nicht unterscheiden.

Für KI-Systeme ist der Zielscheibenfehler eine reale Gefahr. Wenn man genug Variablen testet, findet man immer eine, die mit dem Ergebnis korreliert. In einer ausreichend großen Datenbank gibt es garantiert ein Muster, das vergangene Spiele perfekt erklärt. Das Problem ist, dass dieses Muster keine Vorhersagekraft für zukünftige Spiele haben muss.

Ein Beispiel: Ein Modell stellt fest, dass Teams mit rot-weißen Trikots in der Champions League überdurchschnittlich oft gewinnen. Diese Korrelation mag in den historischen Daten existieren, aber sie hat keine kausale Grundlage. Trikotfarben beeinflussen keine Spielergebnisse. Ein Modell, das solche Scheinkorrelationen lernt, wird bei zukünftigen Prognosen scheitern.

Die Verteidigung gegen den Zielscheibenfehler besteht in der Trennung von Trainings- und Testdaten. Seriöse KI-Systeme entwickeln ihre Modelle auf einem Teil der Daten und überprüfen sie auf einem anderen, unbekannten Teil. Nur Muster, die sich in beiden Datensätzen zeigen, werden als robust betrachtet. Diese Praxis ist fundamental für jede ernsthafte Prognosearbeit.

Überanpassung: Wenn das Modell zu gut ist

Überanpassung, im Englischen Overfitting, ist das statistische Pendant zum Zielscheibenfehler. Ein überangepasstes Modell hat die Trainingsdaten so perfekt gelernt, dass es jede kleine Zufälligkeit erfasst hat. Das Ergebnis ist eine hervorragende Erklärung der Vergangenheit, aber eine schlechte Vorhersage der Zukunft.

Stellen wir uns ein Modell vor, das die Ergebnisse der letzten Champions-League-Saison vorhersagen soll. Ein einfaches Modell basierend auf der Kaderqualität erklärt vielleicht 60 Prozent der Varianz. Ein komplexeres Modell mit hundert Variablen erklärt 95 Prozent. Welches ist besser? Für die vergangene Saison das komplexe, für zukünftige Saisons wahrscheinlich das einfache.

Der Grund liegt in der Natur des Zufalls. Jedes Fußballspiel enthält zufällige Elemente, die sich nicht vorhersagen lassen. Ein Modell, das diese Zufälligkeit erklärt, hat Rauschen gelernt statt Signal. Bei neuen Spielen ist das Rauschen anders, und das Modell versagt.

Die praktische Konsequenz für Nutzer von KI-Prognosen ist, Skepsis gegenüber allzu präzisen Vorhersagen zu bewahren. Ein System, das behauptet, Spielausgänge mit 80 Prozent Trefferquote vorherzusagen, ist entweder revolutionär oder überangepasst. In den meisten Fällen ist es Letzteres. Seriöse Systeme kommunizieren ihre Unsicherheit und liefern Wahrscheinlichkeiten statt Gewissheiten.

Um Überanpassung zu vermeiden, setzen KI-Entwickler verschiedene Techniken ein. Regularisierung bestraft komplexe Modelle und bevorzugt einfachere. Kreuzvalidierung testet das Modell auf verschiedenen Teilen der Daten. Ensemble-Methoden kombinieren mehrere einfache Modelle zu einem robusteren Gesamtmodell. Diese Techniken sind für Endnutzer meist unsichtbar, aber ihre Qualität entscheidet über die Zuverlässigkeit der Prognosen.

Von Wahrscheinlichkeiten zu Quoten und zurück

Eine der praktischsten statistischen Fähigkeiten für Wettinteressierte ist die Umrechnung zwischen Wahrscheinlichkeiten und Quoten. Diese Umrechnung ermöglicht den direkten Vergleich zwischen KI-Prognosen und Buchmacher-Angeboten.

Die Grundformel ist einfach. Eine Wahrscheinlichkeit von 50 Prozent entspricht einer fairen Quote von 2,00. Die Formel lautet: Quote = 1 / Wahrscheinlichkeit. Umgekehrt: Wahrscheinlichkeit = 1 / Quote. Eine Quote von 4,00 impliziert also eine Wahrscheinlichkeit von 25 Prozent.

In der Praxis ist die Sache komplizierter, weil Buchmacher-Quoten eine Marge enthalten. Die Summe der impliziten Wahrscheinlichkeiten für alle möglichen Ausgänge eines Spiels übersteigt 100 Prozent. Dieser Überschuss ist der Gewinn des Buchmachers. Bei einem typischen Champions-League-Spiel liegt die Summe bei etwa 105 bis 108 Prozent.

Um die Marge zu berücksichtigen, muss man die impliziten Wahrscheinlichkeiten normalisieren. Wenn die Summe 106 Prozent beträgt, teilt man jede implizite Wahrscheinlichkeit durch 1,06, um die tatsächliche Markteinschätzung zu erhalten. Erst nach dieser Korrektur ist ein fairer Vergleich mit KI-Prognosen möglich.

Ein Rechenbeispiel verdeutlicht das. Ein Buchmacher bietet für ein Spiel die Quoten 2,10 auf Heimsieg, 3,40 auf Unentschieden und 3,50 auf Auswärtssieg. Die impliziten Wahrscheinlichkeiten sind 47,6 Prozent, 29,4 Prozent und 28,6 Prozent, zusammen 105,6 Prozent. Normalisiert ergeben sich 45,1 Prozent, 27,8 Prozent und 27,1 Prozent. Diese Zahlen kann man nun mit den KI-Prognosen vergleichen.

Wenn das KI-Modell eine Heimsieg-Wahrscheinlichkeit von 52 Prozent berechnet, der Markt aber nur 45 Prozent impliziert, könnte ein Value-Bet vorliegen. Die Differenz von 7 Prozentpunkten ist erheblich und könnte auf eine Fehlbewertung des Marktes hindeuten. Allerdings ist auch möglich, dass das Modell etwas übersehen hat, was der Markt weiß.

Erwartungswert: Die wichtigste Zahl für langfristigen Erfolg

Der Erwartungswert ist das statistische Konzept, das für Wettende am wichtigsten ist. Er gibt an, wie viel Gewinn oder Verlust eine Wette im Durchschnitt über viele Wiederholungen bringt. Ein positiver Erwartungswert bedeutet langfristigen Gewinn, ein negativer langfristigen Verlust.

Die Berechnung ist simpel. Man multipliziert den möglichen Gewinn mit seiner Wahrscheinlichkeit und zieht den möglichen Verlust multipliziert mit dessen Wahrscheinlichkeit ab. Bei einer Wette mit Quote 3,00 und geschätzter Gewinnwahrscheinlichkeit von 40 Prozent ergibt sich: 0,4 × 2,00 (Nettogewinn) minus 0,6 × 1,00 (Einsatz) = 0,80 minus 0,60 = +0,20. Der Erwartungswert beträgt also 20 Cent pro eingesetztem Euro.

Für die Praxis bedeutet das: Nicht die Quote allein entscheidet, ob eine Wette gut ist, sondern das Verhältnis von Quote und Wahrscheinlichkeit. Eine niedrige Quote kann bei hoher Wahrscheinlichkeit profitabel sein, eine hohe Quote bei niedriger Wahrscheinlichkeit ein Verlustgeschäft. Der Erwartungswert integriert beide Faktoren.

KI-Systeme nutzen den Erwartungswert, um Wetten zu priorisieren. Statt einfach alle Spiele mit positiver Gewinnerwartung zu empfehlen, sortieren sie nach dem Erwartungswert und bevorzugen die lukrativsten Gelegenheiten. Ein Spiel mit 5 Prozent Erwartungswert ist wertvoller als eines mit 2 Prozent, auch wenn beide profitabel wären.

Die Schwierigkeit liegt in der Schätzung der Wahrscheinlichkeiten. Der Erwartungswert ist nur so gut wie die Prognose, auf der er basiert. Wenn das Modell die Siegwahrscheinlichkeit systematisch überschätzt, sind auch die Erwartungswerte zu optimistisch. Deshalb ist die Qualität der statistischen Grundlagen so wichtig für den langfristigen Erfolg.

Varianz und Schwankungsbreite: Der unterschätzte Faktor

Selbst bei positiven Erwartungswerten kann kurzfristig viel schiefgehen. Die Varianz misst, wie stark einzelne Ergebnisse vom Erwartungswert abweichen. Eine hohe Varianz bedeutet große Schwankungen, eine niedrige bedeutet stabilere Ergebnisse.

Im Wettkontext ist Varianz besonders bei hohen Quoten relevant. Eine Wette mit Quote 10,00 und 15 Prozent Siegwahrscheinlichkeit hat einen positiven Erwartungswert von 50 Cent pro Euro. Aber in 85 Prozent der Fälle verliert man seinen Einsatz komplett. Die Varianz ist enorm, und Verlustserien von zehn oder mehr Wetten sind normal.

Für das Kapitalmanagement ist die Varianz entscheidend. Wer sein gesamtes Budget auf eine hochvariante Wette setzt, riskiert den Totalverlust, selbst wenn der Erwartungswert positiv ist. Professionelle Ansätze wie das Kelly-Kriterium berücksichtigen die Varianz und empfehlen kleinere Einsätze bei unsicheren Wetten.

KI-Systeme sollten nicht nur Erwartungswerte liefern, sondern auch Informationen über die Unsicherheit ihrer Prognosen. Eine Prognose mit hoher Konfidenz rechtfertigt höhere Einsätze als eine mit niedriger Konfidenz, selbst wenn beide denselben Erwartungswert haben. Leider kommunizieren nicht alle Systeme diese Unsicherheit transparent.

Die praktische Empfehlung ist, die eigene Risikotoleranz zu kennen und die Einsätze entsprechend anzupassen. Wer Verlustserien emotional schlecht verkraftet, sollte auf niedrigvariante Wetten setzen, auch wenn deren Erwartungswert niedriger ist. Langfristiger Erfolg erfordert, im Spiel zu bleiben, und das ist nur möglich, wenn die Varianz zum eigenen Profil passt.

Bayesianisches Denken: Prognosen laufend anpassen

Die klassische Statistik behandelt Wahrscheinlichkeiten als objektive Eigenschaften der Welt. Die bayesianische Statistik hingegen versteht Wahrscheinlichkeiten als Ausdruck von Überzeugungen, die sich mit neuen Informationen aktualisieren lassen. Für Prognosen ist dieser Ansatz oft nützlicher.

Die Grundidee ist, mit einer Vorüberzeugung zu starten und diese schrittweise anzupassen, wenn neue Daten eintreffen. Vor der Saison hat man eine Einschätzung der Teamstärken, basierend auf der Vorsaison und Transferaktivitäten. Nach jedem Spieltag aktualisiert man diese Einschätzung anhand der neuen Ergebnisse.

Die Kunst liegt in der Gewichtung. Wie stark sollte ein einzelnes Ergebnis die Überzeugung verändern? Eine 0:5-Niederlage eines Topteams gegen einen Außenseiter ist überraschend, aber sie macht das Topteam nicht automatisch zum Abstiegskandidaten. Bayesianische Methoden formalisieren diese intuitive Vorsicht und verhindern Überreaktionen auf einzelne Datenpunkte.

Moderne KI-Systeme nutzen bayesianische Ansätze routinemäßig. Sie starten mit Prior-Verteilungen, die das Vorwissen abbilden, und aktualisieren diese mit jedem neuen Spiel. Das Ergebnis sind Prognosen, die sowohl historische als auch aktuelle Informationen berücksichtigen, gewichtet nach deren Relevanz und Zuverlässigkeit.

Für den Endnutzer bedeutet bayesianisches Denken, Prognosen nicht als statische Wahrheiten zu betrachten, sondern als vorläufige Einschätzungen, die sich mit neuen Informationen verändern sollten. Eine Prognose von vor drei Wochen ist weniger relevant als eine von heute, weil seitdem neue Daten eingeflossen sind. Die besten Systeme aktualisieren ihre Prognosen kontinuierlich und kommunizieren, wann sie zuletzt angepasst wurden.

Praktische Tools für eigene statistische Analysen

Wer selbst statistische Analysen durchführen möchte, braucht Zugang zu Daten und Werkzeugen. Die gute Nachricht ist, dass beides heute leichter verfügbar ist als je zuvor.

Für Daten gibt es verschiedene Quellen. Öffentlich zugängliche Plattformen wie FBref bieten detaillierte Statistiken zu den großen europäischen Ligen. Transfermarkt liefert Kaderwerte und Marktwertentwicklungen. Understat spezialisiert sich auf Expected-Goals-Daten. Diese Quellen sind kostenlos nutzbar und bieten eine solide Grundlage für eigene Analysen.

Bei den Werkzeugen reicht die Bandbreite von einfach bis komplex. Tabellenkalkulationen wie Excel oder Google Sheets ermöglichen grundlegende Berechnungen und Visualisierungen. Die Poisson-Verteilung lässt sich mit eingebauten Funktionen berechnen, Regressionen mit Zusatzmodulen durchführen. Für anspruchsvollere Analysen bieten sich Programmiersprachen wie Python oder R an, die umfangreiche Statistikbibliotheken mitbringen.

Ein sinnvoller Einstieg ist die Nachbildung einfacher Modelle. Man nimmt die Expected-Goals-Daten zweier Teams, berechnet mit der Poisson-Verteilung die Ergebniswahrscheinlichkeiten und vergleicht sie mit den Buchmacher-Quoten. Das ist keine Revolution, aber es vermittelt ein Gefühl für die Methodik und ihre Grenzen.

Wichtig ist die Dokumentation der eigenen Arbeit. Man sollte festhalten, welche Daten verwendet wurden, welche Annahmen getroffen wurden und wie die Ergebnisse zustande kamen. Nur so lässt sich später nachvollziehen, ob eine Methode funktioniert hat oder nicht. Ohne Dokumentation ist keine systematische Verbesserung möglich.

Wie viel Statistik braucht man wirklich?

Nach all den Konzepten und Methoden stellt sich die praktische Frage: Wie viel davon muss man tatsächlich beherrschen, um KI-Prognosen sinnvoll zu nutzen?

Die ehrliche Antwort lautet: weniger als man denkt, aber mehr als nichts. Man muss keine Formeln auswendig können und keine Programmiersprache beherrschen. Aber man sollte die grundlegenden Konzepte verstehen, um Prognosen kritisch einordnen zu können.

Das absolute Minimum umfasst drei Dinge. Erstens das Verständnis von Wahrscheinlichkeiten und deren Umrechnung in Quoten. Zweitens das Konzept des Erwartungswerts und seine Bedeutung für langfristigen Erfolg. Drittens ein Bewusstsein für die Grenzen statistischer Prognosen, insbesondere die Probleme von kleinen Stichproben und Überanpassung.

Wer darüber hinausgehen möchte, kann sich mit der Poisson-Verteilung und ihren Anwendungen beschäftigen. Sie ist das Herzstück vieler Torprognosen und erschließt sich mit etwas Übung auch ohne tiefes mathematisches Vorwissen. Die Möglichkeit, eigene Ergebniswahrscheinlichkeiten zu berechnen, erweitert das analytische Repertoire erheblich.

Für die meisten Nutzer ist es jedoch effizienter, auf bestehende KI-Systeme zurückzugreifen, statt selbst zum Statistiker zu werden. Die Arbeitsteilung macht Sinn: Die Algorithmen übernehmen die Berechnungen, der Mensch die kritische Einordnung und die finale Entscheidung. Das setzt voraus, dass man genug versteht, um gute von schlechten Systemen zu unterscheiden, aber nicht, dass man selbst ein System bauen könnte.

Die eigentliche Kompetenz liegt nicht im Rechnen, sondern im Denken. Wer die Logik hinter statistischen Prognosen verstanden hat, erkennt übertriebene Versprechen, hinterfragt scheinbar überzeugende Muster und bleibt realistisch gegenüber den eigenen Erfolgsaussichten. Diese kritische Haltung ist wertvoller als jede technische Fähigkeit.

Die Grenzen statistischer Prognosen im Fußball

Statistik kann viel, aber nicht alles. Es ist wichtig, die Grenzen zu kennen, um realistische Erwartungen zu haben.

Die fundamentalste Grenze ist die Unvorhersehbarkeit einzelner Ereignisse. Statistik arbeitet mit Durchschnittswerten und Wahrscheinlichkeiten, nicht mit Gewissheiten. Eine 70-Prozent-Wahrscheinlichkeit bedeutet, dass in drei von zehn Fällen das Gegenteil eintritt. Das ist keine Schwäche des Modells, sondern liegt in der Natur der Sache.

Eine weitere Grenze betrifft die Datenqualität. Statistische Modelle sind nur so gut wie ihre Daten. Wenn wichtige Informationen fehlen oder fehlerhaft erfasst sind, leiden die Prognosen. Im Fußball sind manche Faktoren, etwa Verletzungen am Spieltag oder taktische Überraschungen, nur schwer vorab zu erfassen.

Auch die Veränderlichkeit der Welt setzt Grenzen. Statistische Modelle basieren auf der Annahme, dass die Vergangenheit die Zukunft vorhersagt. Aber Teams verändern sich, Trainer wechseln, Spielweisen entwickeln sich. Ein Modell, das auf Daten von vor fünf Jahren trainiert wurde, mag für aktuelle Spiele nicht mehr taugen.

Schließlich gibt es die Grenze des Wettbaren. Selbst wenn ein Modell systematisch besser liegt als der Markt, bleibt die Frage, ob dieser Vorteil nach Abzug der Buchmachermarge und der Wettsteuer noch profitabel ist. Kleine Vorteile können durch Transaktionskosten aufgezehrt werden.

Diese Grenzen sind kein Grund zur Resignation, aber zur Demut. Statistische Prognosen sind Werkzeuge, keine Wundermittel. Sie verbessern die Entscheidungsgrundlage, garantieren aber keinen Erfolg. Wer das versteht, kann sie gewinnbringend einsetzen, ohne sich Illusionen hinzugeben.

Statistisches Denken als Lebenskompetenz

Eine letzte Überlegung: Die Fähigkeiten, die man für die Interpretation von KI-Wettprognosen braucht, sind weit über diesen Kontext hinaus nützlich. Statistisches Denken ist eine Lebenskompetenz, die in vielen Bereichen hilft.

Die Fähigkeit, Korrelation von Kausalität zu unterscheiden, schützt vor voreiligen Schlüssen in Alltag und Beruf. Das Verständnis von Stichprobengrößen hilft, Schlagzeilen und Studien kritisch zu lesen. Das Konzept des Erwartungswerts ist bei jeder Entscheidung unter Unsicherheit relevant, nicht nur bei Wetten.

Fußball ist in diesem Sinne ein Übungsfeld. Die Daten sind zugänglich, die Ergebnisse schnell überprüfbar, und die emotionale Beteiligung hält das Interesse aufrecht. Wer hier lernt, statistisch zu denken, nimmt Fähigkeiten mit, die weit über den Sport hinaus wertvoll sind.

Die Ironie ist, dass dieses Wissen einen vermutlich nicht reich machen wird, zumindest nicht durch Sportwetten. Aber es wird einen zu einem besseren Denker machen, und das ist auf lange Sicht mehr wert als jeder Wettgewinn. Die Statistik ist keine Geheimwaffe für schnellen Reichtum, sondern ein Werkzeug für klügere Entscheidungen. Wer das begriffen hat, hat das Wichtigste verstanden.